Noi e voi, dialogo lettori e missionari

Una nuova Tac per Ikonda

Caspita, 316mila euro non sono noccioline. Anche se, per chi sfreccia con i bolidi di «Formula uno», o chi batte e ribatte le palline gialle da tennis, o chi rincorre il variopinto pallone da calcio, 316mila euro sono quasi quisquilie. Ma quisquilie non sono né noccioline per il Consolata hospital Ikonda in Tanzania.

L’ospedale conta 404 posti letto, sei sale operatorie e cura le principali patologie con la presenza di 349 persone: medici, farmacisti, infermieri, tecnici di laboratorio, addetti alle pulizie, ecc. Gli ammalati provengono soprattutto da Morogoro, Iringa, Njombe, Songea, Mbeya, Rukwa, Katavi, ma qualcuno viene anche da più lontano, persino dall’isola di Zanzibar. I bambini del distretto di Makete fino ai 10 anni vengono curati gratuitamente, mentre i pazienti Hiv ricevono alcune prestazioni gratuite, così come le partorienti del distretto.

Il centro sanitario è dei Missionari della Consolata. Fu costruito nel 1962, e successivamente ampliato. Venne inaugurato ufficialmente un anno dopo l’indipendenza del Tanzania con Julius Nyerere presidente, il quale affermava: «I nemici del nostro paese sono la povertà, l’ignoranza e la malattia».

Il Consolata hospital Ikonda affrontò subito «il nemico» malattia.

L’ospedale sorge fra le montagne dell’Ukinga a 2.050 metri di altitudine. Dista circa 800 chilometri da Dar Es Salaam, la capitale del Tanzania. Fino a tre anni fa, gli ultimi 90 chilometri da Njombe a Ikonda erano in terra battuta, una salita scivolosa durante le piogge, rasente precipizi. Oggi da Mbeya giunge ogni giorno un autobus stracolmo di ammalati: affronta nebbie fitte, pantani traditori, pietre massacranti, buche da sprofondare. Il tutto per 7-8 ore, se non capitano guasti meccanici.

Quante volte i missionari della Consolata si sono detti: «Ah, se avessimo costruito l’ospedale altrove, i pazienti l’avrebbero raggiunto più facilmente, e la gestione sarebbe stata più economica». Già. Ma non sarebbe stato l’ospedale dei poveri di Ikonda e dintorni, sferzati dal vento e dal freddo, tagliati fuori dal mondo. È vero, tuttavia, che la lontananza da insediamenti urbani rende più costosa la conduzione della struttura. Alcuni medici e tecnici di laboratorio, dopo aver acquisito una buona esperienza, abbadonano Ikonda; sono attratti da una vita più agiata altrove. L’ospedale cerca di fronteggiare l’esodo con stipendi migliori, mentre investe sulla specializzazione di medici locali in radiologia, medicina interna e medicina d’urgenza. Così è nata pure l’Unità di emergenza.

Un aiuto significativo è la presenza di medici stranieri: italiani, soprattutto, ma anche spagnoli e di altre nazionalità. Sono volontari che si pagano persino il viaggio. Frequentano Ikonda nonostante due «tristezze». La prima tristezza è la povertà di molte persone che non hanno denari per una degenza in ospedale. Seconda tristezza: non raramente i pazienti arrivano «fuori tempo massimo», quando non c’è più nulla da fare.

Ma proprio per tali tristezze i medici volontari ritornano, perché hanno il Tanzania nel cuore. «Tanzania nel Cuore» è anche un’associazione di medici italiani, animati da solidarietà e generosità.

La strumentazione del Consolata hospital Ikonda è apprezzabile. Da anni opera la Risonanza magnetica, mentre dal 2014 è in funzione la Tac, benemerita ma oggi obsoleta. Non si trovano più i pezzi di ricambio. Di qui l’urgenza di un nuovo impianto.

Ed eccola la nuova Tac, fiammante e moderna. L’inaugurazione è avvenuta il 20 settembre 2024 con la presenza dei missionari della Consolata, del direttivo dell’ospedale, del dottor Gian Paolo Zara (di «Tanzania nel Cuore») e del Nunzio apostolico, l’arcivescovo Angelo Accattino (foto qui sotto).

![]()

La presenza del Nunzio non è stata una formalità, bensì la testimonianza che i 316mila euro, per acquistare la Tac sono un dono della Conferenza episcopale italiana: euro raccolti attraverso l’8 per mille degli italiani. Ebbene, manciate e manciate di «noccioline» di tante persone, divenute «un ricco raccolto». Perché l’unione fa la forza.

Dante Alighieri direbbe: «Poca favilla gran fiamma seconda». E Gesù: «Il minuscolo granello di senapa diventa un albero imponente».

Grazie, vescovi e amici italiani, della vostra straordinaria generosità.

padre Francesco Bernardi,

Torino 27/09/2024

A proposito di IA

Ho letto con interesse l’articolo di Chiara Giovetti sull’intelligenza artificiale (IA) pubblicato nel numero di ottobre 2024.

Vi sono molte considerazioni importanti, tra le quali in particolare ho colto la domanda se l’intelligenza artificiale ci aiuterà a trovare soluzioni o se sarà parte dei problemi che si vogliono affrontare.

Resta per me, comunque, un argomento di fondo, non affrontato nell’articolo, il fatto che la cosiddetta «intelligenza» artificiale non è in effetti «intelligenza», ma una serie di algoritmi e istruzioni date alle macchine per conferire loro capacità di analizzare enormi quantità di dati per elaborare documenti (testi, tabelle, progetti, immagini e altro) in tempi brevissimi, a partire da questi dati e da domande poste dagli utenti in modo discorsivo. E fin qui mi è chiaro e l’ho provato anche personalmente.

Ma per far sì che le macchine facciano queste elaborazioni è necessario che abbiano a disposizione i dati necessari.

Mi sono soffermato quindi sulla lista ricavata dall’Unione internazionale delle telecomunicazioni, che include servizi di telemedicina, ottimizzazione dell’uso dell’acqua in agricoltura, riduzione della corruzione negli appalti pubblici, miglioramento della salute e del benessere degli animali in allevamenti, prevenzione di incendi e altro.

Per nessuno di questi esempi nell’articolo si spiega «come» possano essere ottenuti questi risultati.

Riesco da una parte ad immaginare come l’intelligenza artificiale possa essere d’aiuto ad esempio nel caso specifico della telemedicina, dove l’analisi di enormi quantità di cartelle cliniche e/o immagini radiologiche raccolte per tanti anni in tanti archivi medici del mondo certamente può dare informazioni importanti e in tempo immediato e, laddove una ricerca senza intelligenza artificiale richiederebbe tempi lunghi incompatibili con le esigenze di intervento sanitario.

Ma in nessuno degli altri casi portati ad esempio mi pare che si possa fare a meno di dati rilevati in tempo reale, con strumenti anche tecnologicamente avanzati e anche collegati direttamente alle macchine di «intelligenza» artificiale che li possano elaborare, e non a partire da dati storici, per quanto ampi e dettaglianti possano essere.

Tantomeno in casi che riguardano comportamenti umani, come l’esempio della corruzione in appalti pubblici.

Non sono un addetto ai lavori, quindi queste mie osservazioni possono forse essere inadeguate o addirittura fuori luogo.

Ma avendo letto questo articolo in una rivista come Missioni Consolata, che si rivolge a un pubblico come me non preparato su questi argomenti, mi sarei aspettato qualche spiegazione su «come» possa funzionare l’intelligenza artificiale, per non lasciare l’impressione che sia soltanto un business nelle mani di pochi soggetti che sostengono di migliorare il mondo, ma senza far capire come e con quale attendibilità intendano farlo.

Sarei quindi molto grato se fosse possibile avere qualche spiegazione in merito.

Resto in attesa e ringrazio.

Filippo Pongiglione

03/10/2024

Le domande del lettore sono molto interessanti, ma se non ho approfondito i punti che lui fa presenti è solo per mancanza di spazio.

In realtà, non ho fornito più informazioni su che cos’è l’intelligenza artificiale perché sul numero precedente della rivista c’era a pagina 11 un box di Paolo Moiola dal titolo: «IA, di che cosa parliamo». Includere un rimando a quello sarebbe stato in effetti una buona idea.

Quanto ai casi d’uso dell’Unione internazionale delle telecomunicazioni@, fornisco la traduzione e sintesi di alcuni passaggi del rapporto che possono aiutare a capire meglio.

Sul benessere degli animali negli allevamenti in Rwanda.

Posizionando strategicamente negli allevamenti dei sensori per monitorare parametri ambientali chiave come temperatura, umidità e livelli di gas di ammoniaca, oltre a catturare i suoni dei polli, gli allevatori possono adottare misure basate sulle previsioni ricavate dai dati per proteggere la salute e il benessere degli animali, facilitando inoltre il rilevamento precoce di potenziali problemi.

Sulla lotta alla corruzione in Tanzania. Le soluzioni attuali, basate principalmente sui tradizionali meccanismi legali e di audit, faticano a far fronte alla portata e alla complessità delle pratiche corrotte. Il sistema di IA proposto […] dovrebbe elaborare i dati sugli appalti, inclusi documenti di gara, valutazioni e casi di corruzione, per rilevare irregolarità e assegnare una percentuale di probabilità di corruzione […]. Offrire uno strumento anticipatorio consente al Prevention and combating of corruption bureau (Pccb) di adottare misure preventive contro le attività corrotte, migliorando così la trasparenza e garantendo la conformità durante tutto il ciclo di vita degli appalti. […] I vantaggi di questo approccio riguardano il potenziale per il rilevamento della corruzione in tempo reale, l’analisi automatizzata dei documenti e una migliore allocazione delle risorse investigative. Gli svantaggi riguardano invece la difficoltà nella raccolta dati iniziale, possibili pregiudizi nei modelli di intelligenza artificiale e la necessità di competenze tecniche continue e aggiornate.

Sulla prevenzione degli incendi in Malaysia. Il Fire weather index (Fwi), o Indice meteorologico di pericolo d’incendio, è utilizzato in tutto il mondo per stimare il pericolo di incendi@. Nel caso d’uso della Malaysia, invece di usare i dati su temperatura e piogge, come fa il modello esistente, si stima il Fwi – in particolare uno dei sotto indici che lo compongono, il drought code (Dc, indice di siccità) – usando i dati raccolti da strumenti dell’«Internet delle cose» (come sensori, stazioni meteo) su un altro parametro, il livello delle acque sotterranee (Ground water level, Gwl), per poi elaborare i dati attraverso l’apprendimento automatico (machine learning, cioè quella branca dell’intelligenza artificiale in cui – con tutte le virgolette che abbiamo a disposizione – le macchine imparano dalla loro stessa esperienza). Il risultato mostra una correlazione molto alta con i dati osservati dal sistema meteorologico nazionale, rivelandosi quindi piuttosto accurato.

Lieta, comunque, di ricevere domande così circostanziate e stimolanti, che danno anche a me una bella occasione per approfondire ancora.

Chiara Giovetti

07/10/2024

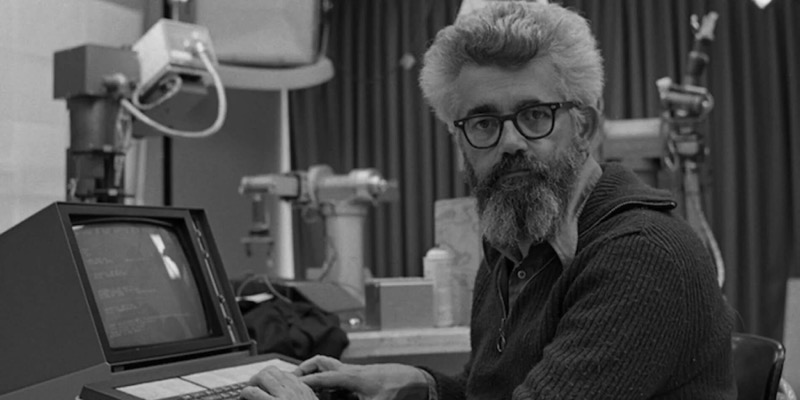

Ad-dio, padre Fernando Paladini

Non dimenticate mai

di salutare bene le persone.

Non fatevi travolgere dal tempo che inghiotte ogni relazione.

Ho lasciato che succedesse a me,

e non dovrà capitare più.

Io e padre Fernando Paladini ci conoscevamo da 34 anni: avevo 14 anni ed è stato il primo dei tanti missionari che ho incontrato nella mia vita. Quello che ha acceso il fuoco della missione nel cuore di una ragazza che cercava un senso per la sua vita.

Ci siamo scritti a lungo quando era in Congo, quando ancora non c’erano i cellulari o whatsapp e si usavano la carta e la penna. Ogni sua lettera era una festa per me: odorava di Africa, aveva l’ennesimo francobollo per la collezione del mio caro papà. Poi, è rientrato in Italia. E io intanto crescevo e mi alimentavo di sogni e di amore per l’umanità. Persone speciali come lui hanno contribuito a farmi diventare quella che sono, mi hanno dato le ali per volare al di sopra di tutto ciò che, di fronte alla povertà e alla passione, diventava sempre più piccolo. Grazie a lui e a chi credeva fortemente in Dio e nei grandi ideali, ho trovato sempre più la mia strada, dove non sono mai stata sola.

Padre Fernando mi chiamava ogni anno il 10 dicembre, per farmi gli auguri per l’onomastico. Non si ricordava quasi nessuno della Madonna di Loreto, ma la sua telefonata arrivava puntuale e fedele come un regalo, con benedizione finale e il classico saluto («Arrivederci ad ogni Eucarestia»).

Quest’anno non mi chiamerà neanche lui. Se ne è andato senza che io lo sapessi. Avrei dovuto essere più presente anch’io.

E invece ho lasciato che gli impegni, le corse, gli affanni quotidiani decidessero per me e per il nostro non saluto.

Ad-Dio, padre Fernando. Ricorderò sempre la tua risata, il tuo entusiasmo, il tuo legame profondo con l’Africa e con il tuo Istituto.

Eri fiero e felice di essere un missionario della Consolata, e sono sicura che domenica 20 ottobre, dal Cielo, ci hai sorriso quando Giuseppe Allamano, il tuo fondatore, è stato proclamato santo.

Grazie infinite per tutto.

Spero che le mie figlie, così come tutti i ragazzi di oggi possano fare incontri come il mio. Di quelli che ti cambiano l’esistenza e le visioni. Di quelli che ti aprono le braccia, gli occhi, la mente.

La maggior parte degli YouTuber e degli influencer non ha niente da dirci. Tu, semplicemente, mi hai toccato il cuore.

Loredana Brigante

19/10/2024

Padre Fernando Paladini, nato a Leverano (Lc) il 25/01/1944, ordinato sacerdote missionario della Consolata il 14/08/1974, nel 1978 parte per il Nord dello Zaire (nella foto è a Pawa nel 1983) dove rimane con breve intervallo, fino al 2016. Rientrato in Italia, ha concluso il suo viaggio missionario il 22/09/2024.